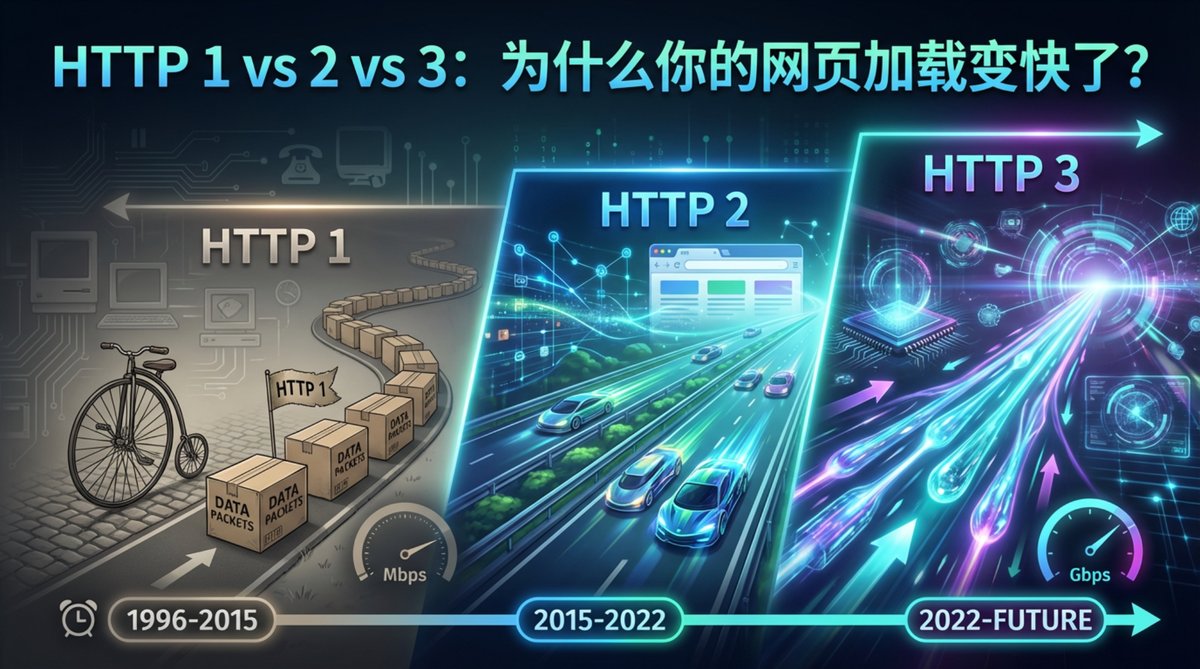

HTTP协议的25年进化史:从简单到极致的性能之旅

写在前面

你有没有想过,当你在手机上刷短视频、在地铁里看直播的时候,背后的网络协议经历了怎样的进化?今天我想和你聊聊HTTP协议这25年的故事——一个关于如何不断打破性能瓶颈、解决真实世界问题的技术演进之旅。

作为一个做了15年运维的人,我见证了从HTTP/1.1到HTTP/3的整个演变过程。这不是一场技术的炫技秀,而是工程师们面对真实痛点,一次次妥协、权衡、突破的过程。

第一幕:1996-1999,互联网的童年

那个握手就要等半天的年代

想象一下1999年的互联网。你打开一个网页,浏览器需要加载HTML、几张图片、一个CSS文件。在HTTP/1.0的世界里,每个文件都需要:

- 建立TCP连接(三次握手)

- 请求文件

- 接收文件

- 关闭连接

然后,下一个文件重复这个过程。

我第一次看到这个流程图的时候,脑海里浮现的是一个画面:你去便利店买东西,每买一样商品都要重新排队、结账、走出店门,然后再进来买下一样。荒谬吗?但1999年的HTTP就是这么工作的。

请求图片1: [握手] → [传输] → [关闭]

请求图片2: [握手] → [传输] → [关闭]

请求CSS: [握手] → [传输] → [关闭]

那个年代,我们管这叫"短连接"。握手的延迟成了最大的敌人。

HTTP/1.1的第一次革命:Keep-Alive

1999年,HTTP/1.1带来了一个看似简单、却影响深远的改变——Keep-Alive(持久连接)。

现在,浏览器可以在一个TCP连接上发送多个请求了:

[握手] → [请求1] → [请求2] → [请求3] → ... → [关闭]

就像你终于可以在便利店一次性买完所有东西,而不用反复进出了。

这个改进统治了互联网整整16年,直到2015年。但它并不完美。

第二幕:HTTP/1.1的阿喀琉斯之踵

队头阻塞:大文件的暴政

Keep-Alive解决了握手延迟,但带来了新问题——队头阻塞(Head-of-Line Blocking)。

想象这样一个场景:你的网页需要加载一个5MB的JavaScript文件,还有3个小小的CSS文件(每个10KB)。在HTTP/1.1的世界里,如果那个大JS文件先开始下载,三个CSS文件只能排队等待。

[========大JS文件(5MB)正在传输========]

← CSS1(10KB) 在等待

← CSS2(10KB) 在等待

← CSS3(10KB) 在等待

你的网络带宽明明还有很多空闲,但就是用不上。这就像高速公路上,一辆大货车占据了所有车道,后面的小汽车再急也只能慢慢跟着。

前端工程师的"缝缝补补"

面对这个问题,前端工程师们想出了各种"骚操作":

1. 域名分片(Domain Sharding)

既然一个域名只能并行6个连接,那我就用多个域名!

static1.example.com

static2.example.com

static3.example.com

看起来很聪明对吧?但这又绕回去了——更多的域名意味着更多的DNS查询,更多的TCP连接。我们在用一个hack解决另一个hack。

2. 资源合并(Concatenation)

把100个小图片合并成一个大的CSS Sprite,把10个JS文件打包成1个。

这招确实减少了请求数,但代价是什么?任何一个小改动都要重新下载整个大文件。缓存效率极低。

3. 内联资源(Inlining)

干脆把CSS、JS直接塞进HTML里。

| |

首屏是快了,但HTML文件膨胀到几MB,而且完全没法复用。

作为一个运维,每次看到前端同事这么折腾,我都觉得这不是解决方案,这是在和协议的缺陷做斗争。我们需要的不是workaround,而是真正的解决方案。

第三幕:2015,HTTP/2的破局之道

二进制分帧:看不见的革命

HTTP/2的第一个改变,普通用户完全感知不到——从文本协议变成了二进制协议。

HTTP/1.1的请求是这样的:

GET /index.html HTTP/1.1

Host: example.com

User-Agent: Mozilla/5.0...

人类能读,但机器解析起来很慢,而且浪费带宽。

HTTP/2变成了这样:

+-----------------------------------------------+

| Frame Header |

+---------------+---------------+---------------+

| Length (24) | Type (8) | Flags (8) |

+---------------+---------------+---------------+

| Payload |

+-----------------------------------------------+

二进制的,紧凑的,机器友好的。这是革命的基础。

多路复用:终于可以并行了

但真正的魔法在于多路复用(Multiplexing)。

现在,一个TCP连接上可以同时传输多个"流"(Stream)。每个流独立编号,数据帧可以交错传输:

Stream 1 (index.html): [帧1] ... [帧2] ... [帧3]

Stream 2 (style.css): ... [帧1] ... [帧2] ...

Stream 3 (script.js): ... [帧1] ... [帧2] ... [帧3]

所有帧在同一个TCP连接上交错传输:

[S1-帧1][S2-帧1][S1-帧2][S3-帧1][S2-帧2]...

那个5MB的JS文件再也不能霸占整个连接了。小文件可以见缝插针,充分利用带宽。

我记得第一次在生产环境启用HTTP/2的时候,页面加载时间直接降低了30%。那些域名分片、资源合并的hack,终于可以扔掉了。

HPACK:别再重复发送那些Header了

HTTP/2的另一个巧思是头部压缩。

你知道吗?每次HTTP请求都会带上一堆重复的Header:

User-Agent: Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7)...

Cookie: session=abc123; user_id=456; analytics=xyz...

Accept: text/html,application/xhtml+xml...

这些东西在一个会话里基本不变,但每次都要传一遍。

HTTP/2用HPACK算法,维护一个"字典表"。第一次发送完整的Header,之后只发送变化的部分:

第一次:User-Agent: Mozilla/5.0... (完整发送)

第二次::path: /new-page (只发送URL变化)

第三次::path: /another-page

在我们的实际业务中,这个优化节省了大约20-40%的Header传输量。不起眼,但积少成多。

Server Push:我知道你要什么

HTTP/2还带来了一个激进的特性——服务器推送。

传统模式:

客户端: 给我index.html

服务器: 好的,给你

客户端: (解析HTML) 哦,还需要style.css和script.js

客户端: 给我style.css

服务器: 好的

客户端: 给我script.js

服务器: 好的

Server Push模式:

客户端: 给我index.html

服务器: 好的,给你index.html,顺便style.css和script.js我也一起发给你了

客户端: (惊喜) 哦,我正要问你要呢

理论很美好,但实际生产中,Server Push的效果并不如预期。因为浏览器缓存的复杂性,很多时候推送的资源其实客户端已经有了,反而浪费带宽。所以这个特性在HTTP/3里被移除了。

第四幕:HTTP/2的隐藏陷阱

TCP层的队头阻塞:换汤不换药?

HTTP/2解决了应用层的队头阻塞,但我们很快发现了一个尴尬的事实——TCP层的队头阻塞依然存在。

想象一下,你有三个流在一个TCP连接上传输:

Stream 1: [帧1][帧2][X帧3丢失][帧4]...

Stream 2: [帧1][帧2][帧3]... ← 等待中

Stream 3: [帧1][帧2][帧3]... ← 等待中

TCP是一个可靠的、有序的传输协议。如果Stream 1的帧3丢失了,TCP会等待重传,所有流都会被阻塞,即使Stream 2和Stream 3的数据已经全部到达。

这就像你在超市排队结账,前面的人掏钱包掏了半天,你再急也得等着,哪怕你的东西早就扫完了。

在弱网环境(比如地铁里的移动网络),丢包率可能达到1-5%。这时候HTTP/2的性能反而可能比HTTP/1.1还差。

我在2018年做过一次测试,在模拟的弱网环境下(3%丢包率),HTTP/2的延迟竟然比HTTP/1.1高了15%。这是一个大问题。

第五幕:HTTP/3的革命——抛弃TCP

QUIC:用UDP重新发明轮子

Google的工程师们做了一个大胆的决定:既然TCP有问题,那就不用TCP了。

他们基于UDP协议,从头实现了一个新的传输层协议——QUIC(Quick UDP Internet Connections)。

HTTP/2 的协议栈:

┌─────────────┐

│ HTTP/2 │

├─────────────┤

│ TLS 1.3 │

├─────────────┤

│ TCP │ ← 内核实现,改不了

├─────────────┤

│ IP │

└─────────────┘

HTTP/3 的协议栈:

┌─────────────────────────┐

│ HTTP/3 │

├─────────────────────────┤

│ QUIC │ ← 用户态实现,可以快速迭代

│ (可靠性+加密+拥塞控制) │

├─────────────────────────┤

│ UDP │

├─────────────────────────┤

│ IP │

└─────────────────────────┘

为什么是UDP?因为UDP简单、无状态,内核实现稳定。在UDP之上,QUIC重新实现了可靠性、拥塞控制、加密——但这次是在用户态,可以快速迭代改进。

0-RTT:快到不可思议的握手

TCP+TLS建立连接需要2-3个往返时间(RTT):

客户端 服务器

| |

| -------- SYN ---------> | \

| <----- SYN-ACK ------- | } TCP握手 (1 RTT)

| -------- ACK ---------> | /

| |

| ---- ClientHello ----> | \

| <---- ServerHello ---- | |

| <---- Certificate ---- | } TLS握手 (1-2 RTT)

| -- ClientKeyExchange -> | |

| ---- Finished --------> | /

| |

| -------- Data ---------> |

总共2-3个RTT才能开始传输数据。如果你在新加坡访问美国的服务器,单程延迟200ms,光握手就要花400-600ms。

QUIC的首次连接只需要1-RTT:

客户端 服务器

| |

| -- Initial (含密钥) --> | \

| <--- Handshake ------- | } 1-RTT

| -------- Data ---------> |

更激进的是,如果你之前连接过这个服务器,QUIC可以做到0-RTT:

客户端 服务器

| |

| - 0-RTT Data (含会话票据) -> | 0-RTT!数据直接发送

第一个数据包就带着实际请求,不需要等待任何握手。

我第一次看到0-RTT的效果时,真的惊呆了。在我们的CDN上,平均首字节时间(TTFB)降低了50ms以上。对于移动端用户,这是巨大的提升。

真正的流独立:彻底解决队头阻塞

QUIC的流是真正独立的:

Stream 1: [帧1][帧2][X丢失][帧4] ← 只有Stream 1阻塞

Stream 2: [帧1][帧2][帧3][帧4] ← 正常传输

Stream 3: [帧1][帧2][帧3][帧4] ← 正常传输

一个流丢包,只影响这个流自己。其他流该怎么传就怎么传。

在移动网络环境下,这个特性太关键了。用户在地铁里刷视频,信号时好时坏,QUIC能保证即使部分数据丢失,其他内容依然流畅加载。

连接迁移:从WiFi切到4G,连接不断

这可能是QUIC最贴近移动用户体验的特性了。

TCP连接是由四元组标识的:(源IP, 源端口, 目标IP, 目标端口)。当你从WiFi切换到4G,IP地址变了,TCP连接就断了,需要重新建立。

家里WiFi(192.168.1.100) → 地铁4G(10.x.x.x)

↓

TCP连接断开

↓

重新握手(1-2 RTT)

QUIC用**连接ID(CID)**标识连接,而不是四元组。IP变了没关系,连接ID不变,连接就还在:

WiFi(192.168.1.100) → 4G(10.x.x.x)

↓

连接ID: abc123 (不变)

↓

连接无缝切换

作为一个经常通勤的人,我太懂这个痛点了。以前看YouTube,出了地铁站,从4G切到WiFi,视频会卡顿重新缓冲。现在有了QUIC,这个过程完全无感。

第六幕:现状与抉择

现在,三个世界并存

截至2024年,互联网上大约:

- 30%的流量还在用HTTP/1.1 - 主要是内部API、遗留系统

- 60%在用HTTP/2 - 这是当前的主流标准

- 25%已经切换到HTTP/3 - 而且这个数字在快速增长

你应该用哪个?

这是我最常被问到的问题。我的答案是:看场景。

继续用HTTP/1.1,如果:

- 你的服务是内网API,延迟本来就很低

- 你需要用tcpdump这类工具调试,可读性很重要

- 你的客户端不支持新协议(比如某些老旧的IoT设备)

升级到HTTP/2,如果:

- 你是面向公网的Web服务

- 你的用户主要用现代浏览器

- 你希望优化带宽利用率

- 这是当下最稳妥的选择

激进地上HTTP/3,如果:

- 你的用户是移动端为主

- 你做视频流、直播这类实时性要求高的业务

- 你的用户在弱网环境(比如东南亚、印度)

- 你追求极致的首屏速度

我的实际经验

在我们公司,我们是这样做的:

- API服务器(内网):保持HTTP/1.1,简单可靠,便于调试

- Web前端(CDN):全面启用HTTP/2,必要时自动降级HTTP/1.1

- 移动端App:逐步迁移到HTTP/3,用Cloudflare的边缘网络支持

迁移过程中,最重要的是做好监控。我们会追踪:

- 各协议的使用率

- 平均延迟(P50、P95、P99)

- 错误率

- 连接复用率(HTTP/2/3特有)

- 0-RTT成功率(HTTP/3特有)

尾声:技术的意义

写到这里,我突然想起2019年的一件事。

我们的一个客户做在线教育,用户主要在印度。他们反馈视频加载很慢,转化率很低。我们帮他们分析发现,印度的移动网络丢包率平均在3-5%,高峰期能到10%。

我们把他们的CDN切换到支持HTTP/3的节点,同时优化了QUIC的拥塞控制参数。一周后,他们的数据变成了这样:

- 视频首帧时间从4.5秒降到1.8秒

- 卡顿率从18%降到5%

- 最终转化率提升了23%

这就是技术的意义。不是为了炫技,不是为了写在PPT上,而是真正解决实际问题,给真实的人带来更好的体验。

HTTP从1.1到2到3的进化,本质上是工程师们在不断回答同一个问题:如何让数据传输更快、更稳定、更高效。

25年了,这个问题还在继续,答案也在继续演进。

也许再过5年,我们会在这里讨论HTTP/4。但无论如何,这个不断打破瓶颈、持续优化的过程,正是我热爱这个行业的原因。

如果你对HTTP协议的技术细节感兴趣,欢迎在评论区讨论。如果你在生产环境中有HTTP/2或HTTP/3的实践经验,也欢迎分享。

下一篇,我们聊聊QUIC协议的拥塞控制算法,以及在高丢包率环境下的调优实践。